17. Februar 2025Peter Pionke

Fake-News erkennen – Eine gesamtgesellschaftliche Aufgabe

Hendrik Heuer, Professor für Design vertrauenswürdiger Künstlicher Intelligenz an der Bergischen Universität – © UniService Third Mission

Hendrik Heuer, Professor für Design vertrauenswürdiger Künstlicher Intelligenz an der Bergischen Universität – © UniService Third MissionHendrik Heuer, Professor für Design vertrauenswürdiger Künstlicher Intelligenz an der Bergischen Universität erforscht, ob und wie Nutzerinnen und Nutzer Vertrauen in KI-Systeme aufbauen können mit dem Ziel, neue soziale Medien von und für Nutzer zu entwickeln. Autor Uwe Blass hat sich im Rahmen der beliebten Uni-Reihe „Transfergeschichten“ mit de Wissenschaftler über das spannende Thema unterhalten.

Verständnis, Kontrolle, Mitgestaltung

„Wir brauchen ein grundsätzliches Verständnis“, sagt Heuer, „wir müssen schon grob verstehen, wie ein ChatGPT (ChatGPT ist ein Chatbot des US-amerikanischen Softwareunternehmens OpenAI, mit dem Nutzer über textbasierte Nachrichten und Bilder kommunizieren können, Anm. d. Red.) die Sachen berechnet, damit man bestimmte Fehler auch früher erkennen kann. Wir brauchen auch Möglichkeiten zur Kontrolle, wo wir die Ausgabe, also was aus diesem KI-System rauskommt, ganz systematisch angucken und, ganz zentral geht es um die Frage der Mitgestaltung. Ich komme aus dem Bereich der partizipativen Softwareentwicklung und daher glaube ich, dass auch die Menschen immer ein Teil der Softwareentwicklung sein sollten.“

© Bergische Universität

© Bergische UniversitätDieser letzte Gedanke sei schon seit den 70er Jahren bekannt und man wisse, dass man Leute, die Software nutzen, tunlichst an der Entwicklung beteiligen sollte, da sie Expertinnen und Experten für ihre Arbeit sind. „Wenn wir das besser zusammenbringen, dann haben wir KI, von der wir sagen, der traue ich zu, dass sie Vorgänge automatisiert. Dieser KI vertraue ich.“

Kampf gegen Falschinformationen ist eine gesamtgesellschaftliche Aufgabe

Zu Heuers Forschung gehört auch der Kampf gegen Miss- und Desinformationen, den man bei der Flut an Tagesnachrichten kaum gewinnen kann. „Das ist ein dickes Brett, dass wir bohren müssen“, lacht der Fachmann, der mit seinem Team kürzlich bei einem Kongress des Chaos-Computer-Klubs einen Vortrag mit dem Titel „Von Augustus bis Trump“ gehalten hat, und damit belegt, dass Fake-News schon seit der Antike genutzt wurden, um sich einen politischen oder persönlichen Vorteil zu verschaffen. Im Unterschied zu damals habe man aber heute KI-Systeme, die viel schneller Falschinformationen generieren können sowie Soziale Medien, über die man viel mehr Menschen erreichen könne. „Auch, wenn es ein Kampf gegen Windmühlen ist, müssen wir da ran. Es ist eine gesamtgesellschaftliche Aufgabe!“

Technische Unterstützung durch geeignete Werkzeuge

„Wir schauen z. B., was man auf technischer Ebene machen kann“, erklärt der Wissenschaftler, „mit welchen Werkzeugen man die Leute unterstützen kann.“ Die Forschung zeige, dass das auch funktioniert. Es gebe bestimmte Sachen wie Crowdsourcing (Crowdsourcing setzt sich aus den Begriffen „Outsourcen” und „Crowd” zusammen. Gemeint ist, dass bestimmte Aufgaben und Arbeitsprozesse an die Masse der Internetnutzer, die Crowd, ausgelagert werden, Anm. d. Red.), Checklisten oder Nachrichtenzuverlässigkeitskriterien. Wenn man den Menschen auf der Medienbildungsebene bestimmte Sachverhalte erkläre, dann könne man sie wirklich dazu bringen, Falschinformationen besser zu erkennen. „Wenn ich bestimmte Dinge schon mal gesehen habe, erkenne ich sie beim nächsten Mal schneller.“

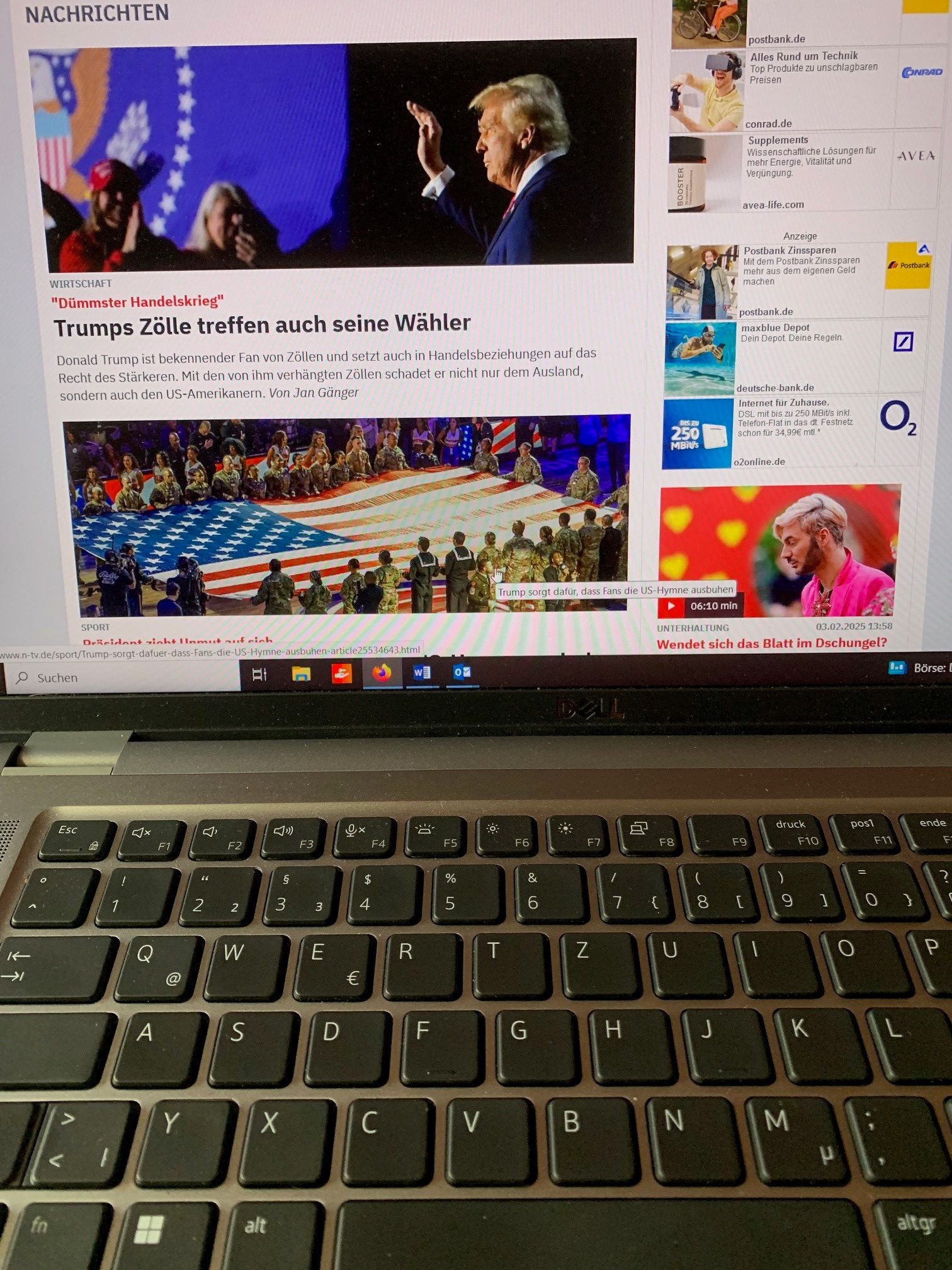

Nachrichten im Netz lassen sich oft schwer auf ihren Wahrheitsgehalt überprüfen – © Foto: UniService Third Mission

Nachrichten im Netz lassen sich oft schwer auf ihren Wahrheitsgehalt überprüfen – © Foto: UniService Third MissionWie kann man Soziale Medien verbessern?

Ein besonderer Fokus von Heuers Arbeit liegt auf den Sozialen Medien und auf der Frage, wie sie verbessert werden können. Schon lange beschäftigt er sich daher bereits mit Plattformen wie z. B. X, vormals Twitter, oder Facebook. Er denkt aber außerdem, dass neue, unabhängige Plattformen entwickelt werden können. „Ich habe die Idee, wenn wir aus der Gleichung mal rausnehmen, dass wir mit Werbung ganz viel Geld machen müssen, wir alleine hier in Wuppertal mit den Informatikstudierenden eine Plattform bauen könnten, die die meisten Leute für ihre Familie, ihre Hobbies, ihren World-of-Warcraft-Clan oder welche Gruppe ihnen auch immer wichtig ist, nutzen können, um damit Bilder zu teilen und eine gute Zeit zu haben. Ich würde im Kleinen anfangen.“

Hendrik Heuer sucht also schon bestehende Gruppen, um diese mit Knowhow zu unterstützen und maßgeschneiderte Plattformen für sie zu entwickeln. In Kooperation mit einer berufsbildenden Schule in Wuppertal probiert er bereits verschiedene Möglichkeiten aus. „Ein einmal geschriebenes Programm kann dann für viele Anwendungen genutzt werden.“

In einem Projekt mit Klimaaktivistinnen, die sehr viel mit Instagram arbeiten und sich gegen jede Art von sexueller Gewalt und Hass im Netz zur Wehr setzen wollen, prüft Heuer mit seinem Team, ob auch Filtermöglichkeiten über den Browser Abhilfe schaffen können.

Die Linux-Idee wieder salonfähig machen

„Ich bin ein großer Fan von Linux (Linux bezeichnet freie Mehrbenutzer-Betriebssysteme, Anm. d. Red.), dieser großen Linuxidee, den Programmiercode allen zu geben, so dass alle ihn auch verändern können“ sagt Hendrik Heuer begeistert. „Das ist eine tolle Idee! Auf jedem Android-Handy läuft Linux, auf fast allen Internetservern – das ist eine riesige Erfolgsgeschichte. Aber diese Idee, mit der sie reingegangen sind, den Programmiercode ändern zu können, wird nicht umgesetzt. Ich bin Informatikprofessor, ich habe den noch nie geändert, meine Eltern haben den noch nie geändert, da fehlt noch was. Die Frage ist, wie können wir das wieder zurückholen und nutzbar machen?“

KI generierte Blume – © Pixabay

KI generierte Blume – © PixabayAn dieser Stelle, erklärt er, kommen wieder KI-Möglichkeiten ins Spiel, wobei das Präzisieren von Begriffen das A und O ist. Hendrik Heuer erklärt es so: „Stellen sie sich vor, es gibt die Begriffe Fahrrad, Auto und Raumschiff nicht. Das wird alles Fortbewegungsmittel genannt. Und nun kommen Leute in einen Laden, die brauchen eigentlich ein Fahrrad, bekommen aber ein Raumschiff verkauft, oder ein Auto mit einem Raumschiffpreis. Das ist eigentlich heute der Standard in KI. KI ist alles und nichts und da brauchen wir für die Nutzerinnen und Nutzer präzisere Begriffe.“ Große Sprachmodelle, die auch bei ChatGPT verwandt würden, könnten von Usern mitgestaltet werden.

Die Beurteilung von Informationen – frag jemanden in deinem Umfeld

Viele Nutzer Sozialer Medien sehen sich häufig nicht in der Lage, Falschinformationen zu erkennen. Doch auch da weiß der Fachmann einen Rat. „Die ganz klassische Nummer ist die Nachricht, die zu gut klingt, um wahr zu sein, die ist dann meistens auch falsch“, erklärt Hendrik Heuer, „das gilt auch für Sachen, die sehr emotional sind. Es ist immer auch ein sozialer Prozess, d.h. man sollte Leute in seinem Umfeld fragen.“ Verschiedene Studien hätten bereits gezeigt, dass es Kriterien gebe, Informationen einzuordnen.

„Einmal sind es die Inhalte. Sind sie besonders außergewöhnlich, kann man alternative Medien oder Zeitungen heranziehen, die auch darüber berichten. Der zweite Punkt ist die politische Ausrichtung von etwas. Wenn sich z. B. eine Internetseite zu einer bestimmten Partei verhält und das Parteilogo auf der Seite hat, dann ist das nicht das, was wir vom Journalismus erwarten. Oder man kann sich bei Wikipedia schlau machen, indem man im Artikel für eine Nachrichtenquelle die Kritikpunkte anschaut. Wichtig ist: Man sollte die Webseite, die man prüfen will, verlassen und auf anderen Webseiten, denen man vertraut, Informationen sammeln.“

KI generierte Frau – © Pixabay

KI generierte Frau – © PixabayTextmanipulation durch veränderten Schreibstil

Die Bundestagswahlen stehen vor der Tür. Die Wählerinnen und Wähler sind unsicherer als jemals zuvor und die Möglichkeiten der Vermittlung von Falschinformationen, gerade in diesem sehr kurzen Wahlkampf, sind besonders vielfältig. Hendrik Heuer hat zusammen mit einer Kollegin der Harvard Universität die Glaubwürdigkeit von Nachrichtenwebseiten untersucht, dazu Journalisten und Politiker befragt und sagt: „Als Kriterien hatten wir u.a. bestimmte Inhalte wie Verschwörungstheorien, ob stark mit bestimmten politischen Parteien zusammengearbeitet wird, wer für eine Seite als Autor oder Autorin tätig wird, ob journalistische Standard eingehalten werden und wem eine Webseite gehört.“

KI-Systeme sind sehr empfänglich für Aufmerksamkeit

Bis zu 70 Prozent der auf YouTube angesehenen Videos werden von einem KI-System ausgewählt. Wenn so ein System erwiesenermaßen auch auf Freundschaften und Bekanntschaften Einfluss nimmt, kann es vielleicht auch politischen Einfluss nehmen und dann wird’s gefährlich. „Vor allem seitdem es TikTok gibt, wird noch mehr durch KI ausgesucht“, erklärt der Fachmann.

„Wie sehr KI da auf Politik Einfluss nehmen kann, ist aber auch sehr schwer erforschbar. Einige wenige KI-generierte Beeinflussungen ändern vielleicht noch nicht mein Wahlverhalten, aber in der Summe macht das natürlich schon was mit den Leuten. Die Nachrichten, die ich mir in Summe angucke, haben sicher einen Einfluss darauf, wie ich die Welt wahrnehme. Und daher sollten wir als Forschende auch darauf aufpassen, dass die Nachrichten, die wir sehen, auch wirklich Nachrichten sind und keine ausgedachten Sachen, die ein politisches Ziel verfolgen.“

KI-Systeme sind sehr empfänglich für Aufmerksamkeit, und daraus kann sich ein Problem entwickeln. Dazu Hendrik Heuer: „Wenn da eine Nachricht ist, über die viel geredet wird, und das kann auch eine Falschinformation sein, macht der Algorithmus keinen Unterschied zwischen Bedeutung und Beachtung. Wenn etwas viel Beachtung findet, freut es sich, zeigt es noch mehr Leuten und dann findet es noch mehr Beachtung. Man weiß auch, dass gerade stark emotionalisierende Sachen sehr viel Beachtung finden. Und da muss man ran. Wenn wir also sagen, wir haben hier eine Plattform und die ist eher wie unsere Tagesschau, insofern, als dass ich das abends mal eine viertel Stunde anschaue, ist das eine andere Herangehensweise und passt so gar nicht ins Geschäftsmodell von den aktuellen Plattformen, die mit Werbung viel Geld verdienen.“ Heuer erlebt aber auch bereits Veränderungen. So hätten viele Journalisten die Plattform „X“ mittlerweile verlassen und sich bei „Bluesky“ angemeldet. „Es ist also nichts in Stein gemeißelt.“

KI generiertes Schwein © Pixabay

KI generiertes Schwein © PixabayNichts muss so sein, wie es scheint

„Man muss wieder mehr miteinander reden“, sagt Hendrik Heuer bestimmt, „denn auch wenn eine Info 40.000 Likes hat, muss sie nicht richtig sein. Das kann man alles sehr leicht manipulieren. Ich finde nicht, dass man diesen Zahlen trauen darf, wir müssen unsere eigenen Zahlen sammeln.“ Wie könnten also nutzerfreundliche Soziale Medien der Zukunft aussehen? Die Antworten der User sind dazu überraschend einfach. „Wenn man fragt, wie stellt ihr euch denn die Sozialen Medien der Zukunft vor, dann sind die Sachen, die die Leute wollen, Kontakte zu Freundinnen und Freunden und Familie oder Informationsaustausch zu den Hobbies“, erklärt Hendrik Heuer.

„Das ist alles kein Hexenwerk, aber das zu unterstützen, das ist unsere Forschungsarbeit, das finden wir gerade heraus. Wir arbeiten da mit Prototypen, weil es immer leichter ist, etwas zu zeigen und erfahren dann, ob es passt, oder was verändert werden muss.“ Den Erfolg seiner Arbeit sieht der Informatiker vor allem im Austausch mit den Nutzerinnen und Nutzern. „Die Leute wissen eigentlich, was sie brauchen. Da brauchen wir Kommunikation, Offenheit und Vertrauen.“

Uwe Blass

Hendrik Heuer – © UniService Third Mission

Hendrik Heuer – © UniService Third MissionÜber Prof. Hendrik Heuer

Hendrik Heuer studierte Digitale Medien an der Universität Bremen und absolvierte anschließend ein Masterstudium an der Königlichen Technischen Hochschule Stockholm und der Aalto Universität in Helsinki. 2020 promovierte er zum Thema Mensch-Computer-Interaktion & Maschinelles Lernen an der Universität Bremen. Dort arbeitete er anschließend als Postdoc und Vertretungsprofessor. Er war außerdem Postdoc an der Harvard Universität in den USA. Seit 2024 forscht und lehrt er gleichzeitig zum Thema Design vertrauenswürdiger Künstlicher Intelligenz am Center for Advanced Internet Studies (CAIS) in Bochum und der Fakultät für Mathematik und Naturwissenschaften an der Bergischen Universität.

Weiter mit:

Kommentare

Neuen Kommentar verfassen